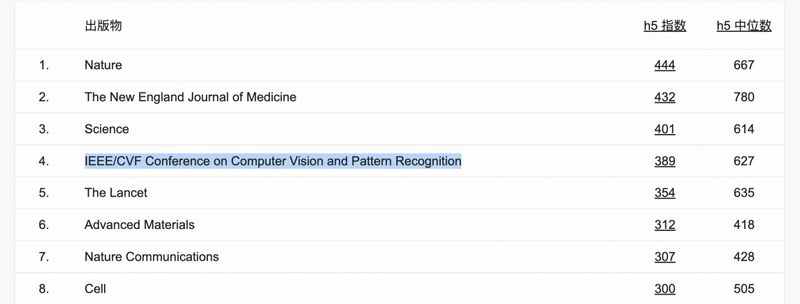

近日,2022年度国际计算机视觉与模式识别会议CVPR (IEEE Conference on Computer Vision and Pattern Recognition) 在美国新奥尔良以线上线下混合形式举行。CVPR是由IEEE举办的计算机视觉和模式识别领域的顶级会议,在今年刚统计的谷歌学术期刊和会议影响力排行榜中,CVPR保持总榜第4,仅次于Science,是人工智能领域影响力最高的会议。

谷歌学术2022学术指标

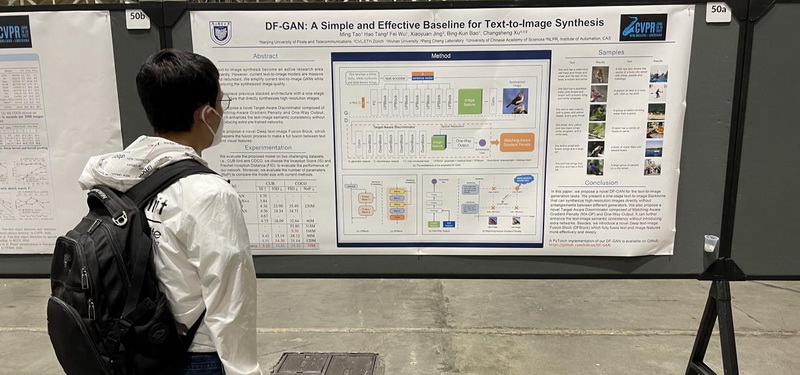

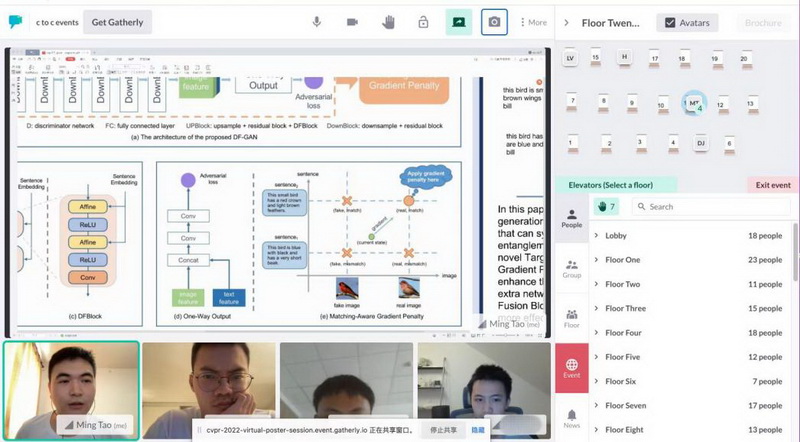

本次CVPR共收到8161篇投稿,2064篇论文被接收,其中340篇优秀的论文被接收为Oral论文,仅占总投稿数量的4%。我校通信与信息工程学院,鲍秉坤教授团队的基于文本生成图像的研究成果(DF-GAN: A Simple and EffectiveBaseline for Text-to-Image Synthesis)被大会接收为口头汇报论文(Oral Presentation),论文一作、我院博士生陶明同学参加了会议,并于会上分享了研究成果以及讨论了文本到图像生成的应用与未来。

DF-GAN提出后,对文本到图像生成领域产生了巨大的影响,截至目前谷歌学术引用近百篇,被国际知名机构包括OpenAI、Facebook、Google、微软、智源、百度、字节、京东、达摩院等正面评价或扩展,并引发了大量的跟随研究,包括DTGAN、SSA-GAN、OptGAN、CIGLI、SketchBird、Vastr-GAN、RAT-GAN等模型。

论文被选为口头汇报

会议现场的海报

陶明同学在线上会议进行论文分享

论文介绍

论文题目:DF-GAN: A Simple and EffectiveBaseline for Text-to-Image Synthesis

作者:陶明,唐浩,吴飞,荆晓远,鲍秉坤,徐常胜

通讯作者:鲍秉坤

论文概述:

根据文本生成图像任务要求计算机能够由文本生成对应的图片,由于其为创作带来的便利性,使其在互联网时代有着重要的研究价值和意义。该任务会给定一段文本,要求模型能够充分理解文本中蕴含的语义信息,并将文本中的语义信息映射为图像中对应的视觉信息,从而得到真实且符合文本描述的图像。

利用生成对抗网络进行对抗学习是解决该任务的主要方法之一,在对抗学习中,判别器需要区分生成图片和真实图片,而生成器则需要生成足够逼真的图片,使得判别器无法区分生成的和真实的图片,通过生成器和判别器之间的互相博弈,从而提高生成图片的质量。

该论文提出了一个简单且有效的一阶段文本到图像生成框架,它可以直接由文本生成高分辨率的图片,避免了多阶段框架带来的特征纠缠问题。在生成器中,提出了一个深度文本-图像融合模块,通过堆叠基于文本的图像仿射变化,加深了文本与图像的特征融合,从而使得文本信息能够更好地表达在图片中。在判别器中,提出了一个目标感知判别器,它由两部分组成,包括一个匹配感知梯度惩罚策略和一个单路判别器。这两个模块构造了一个利于收敛到目标图片的判别器损失曲面,使得模型可以更快且稳定地收敛,从而使得模型得到更好的优化。通过定性和定量的实验表明,所提出的方法在简化当前生成网络的同时,优化了生成图像的质量,并且提高生成图像与文本的匹配度。

(撰稿:张涛 编辑:吕瑞兰 审核:徐雷)